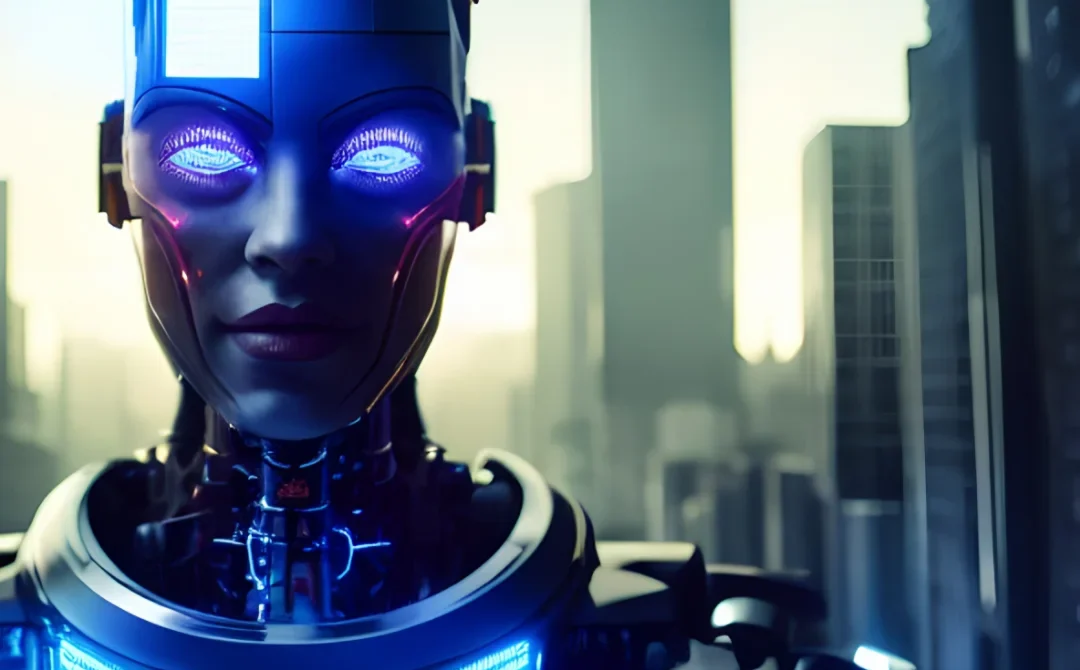

O rosto é familiar, a voz parece idêntica, mas a mensagem é fabricada. Em abril de 2026, o limite entre o real e o artificial nunca foi tão tênue. Um novo levantamento da Agência Lupa, divulgado nesta semana, revela um cenário alarmante: 81,2% dos casos de desinformação gerados por Inteligência Artificial (IA) surgiram apenas nos últimos dois anos (entre janeiro de 2024 e março de 2026).

O estudo, intitulado “O impacto da IA no Fact-checking Global”, analisou 1.294 checagens profissionais em dez idiomas. O veredito dos especialistas é claro: a IA está sendo usada massivamente para criar conteúdos falsos ou enganosos, especialmente em temas sensíveis como eleições, guerras e crises institucionais.

O Boom da Desinformação Digital

O crescimento das mentiras “automatizadas” é exponencial. Enquanto em 2023 foram registrados 160 casos de desinformação por IA, esse número saltou para 578 em 2025. Apenas nos primeiros três meses de 2026, os checadores já flagraram 205 verificações desse tipo.

Ranking por Idioma

Embora a desinformação seja global, o estudo aponta volumes distintos por língua:

-

Inglês: 427 casos (foco em deepfakes).

-

Espanhol: 198 casos.

-

Português: 111 casos (com foco crescente no cenário brasileiro).

Eleições 2026: O Desafio da Democracia

Com o Brasil e outros países da região em períodos eleitorais decisivos, a fundadora da Lupa, Cristina Tardáguila, alerta para uma “enxurrada de conteúdos falsos”. A IA deixou de ser uma ferramenta pontual para se tornar parte permanente do arsenal de desinformação digital.

Vídeos manipulados, áudios clonados e textos gerados automaticamente têm como objetivo confundir o eleitor e desestabilizar processos democráticos. Para a pesquisadora, a maioria das peças analisadas pelos checadores acaba levando a etiqueta de falso ou enganoso, pois a IA raramente tem sido usada para impulsionar a verdade.

A “Vacina” contra a Mentira: Educação Midiática

Se a desinformação é o vírus, a informação de qualidade e a educação midiática são a vacina. Especialistas defendem que o poder público e as instituições de ensino implementem com urgência políticas de literacia digital.

“Precisamos que a informação de qualidade chegue antes, para que as pessoas estejam preparadas e resilientes quando virem a mentira em formato de IA”, ressalta Tardáguila.

Como você pode se proteger?

-

Desconfie do imediato: Conteúdos muito chocantes ou “perfeitos demais” geralmente são suspeitos.

-

Verifique a fonte: Procure a mesma notícia em veículos de comunicação tradicionais ou agências de checagem.

-

Analise os detalhes: Em vídeos (deepfakes), observe piscadas de olhos artificiais, falhas na sincronia labial ou sombras estranhas no rosto.

-

Não compartilhe na dúvida: O compartilhamento rápido é o que alimenta o algoritmo da mentira.

O Papel das Agências de Checagem

Em 2026, as agências de checagem utilizam critérios rigorosos de transparência para desmentir o que a IA cria. Qualquer cidadão pode (e deve) consultar ferramentas gratuitas, como o Fact Check Explorer do Google, para verificar se uma informação já foi desmascarada.